Les cybercriminels adoptent massivement l'intelligence artificielle

Le dernier rapport de Microsoft Threat Intelligence met en lumière une évolution majeure du paysage des cybermenaces : l'intégration systématique de l'intelligence artificielle générative dans les opérations malveillantes. Cette adoption massive transforme radicalement les méthodes d'attaque, permettant aux cybercriminels d'accélérer leurs opérations et de réduire considérablement les barrières techniques.

Évolution des menaces

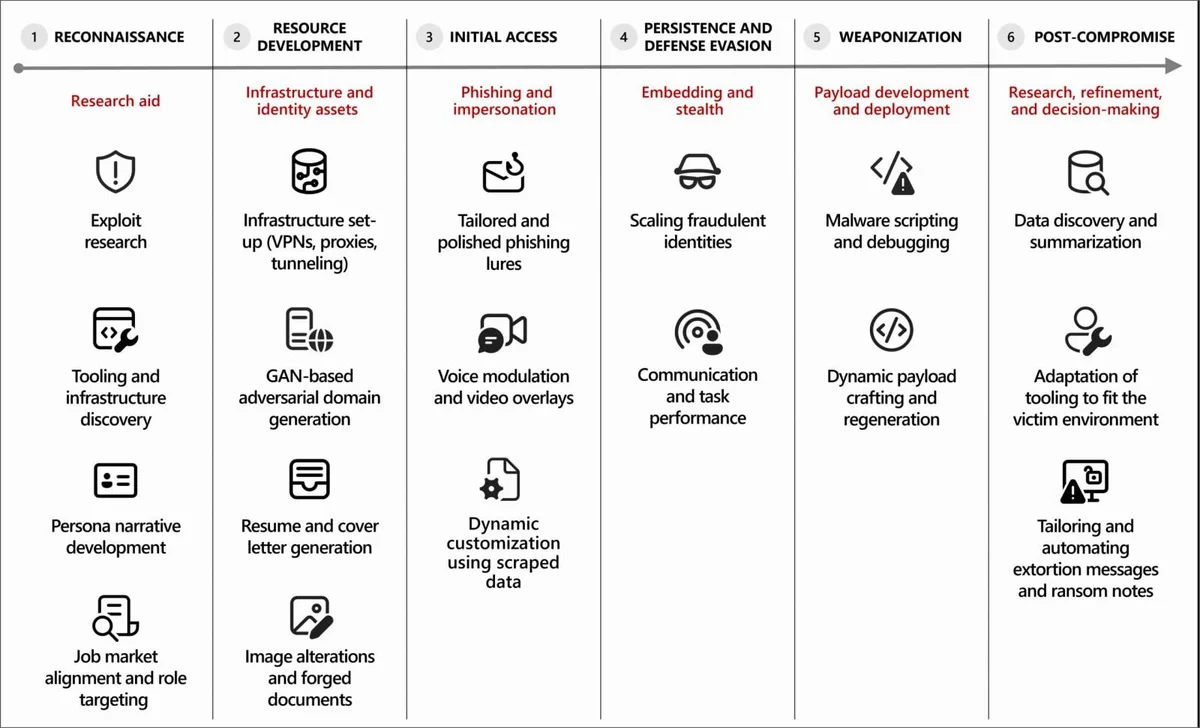

Les acteurs malveillants exploitent désormais l'IA générative à toutes les étapes de leurs campagnes : reconnaissance, phishing, développement d'infrastructure, création de malwares et activités post-compromission.

Selon les analystes de Microsoft, cette technologie fonctionne comme un multiplicateur de force qui diminue les frictions techniques tout en préservant le contrôle humain sur les objectifs stratégiques et les décisions de déploiement.

Applications concrètes de l'IA dans les cyberattaques

Automatisation de la création de contenu malveillant

Les outils d'IA générative sont principalement utilisés pour produire du texte, du code et des médias malveillants. Les cas d'usage observés incluent :

- Rédaction d'e-mails de phishing personnalisés et convaincants

- Traduction automatique pour cibler des populations multilingues

- Synthèse de données volées pour faciliter leur exploitation

- Génération et débogage de malwares avec assistance technique

- Configuration d'infrastructures d'attaque automatisées

Cas d'étude : les groupes nord-coréens Jasper Sleet et Coral Sleet

Microsoft a documenté l'utilisation sophistiquée de l'IA par plusieurs groupes de menaces, notamment les acteurs nord-coréens Jasper Sleet (Storm-0287) et Coral Sleet (Storm-1877), spécialisés dans les schémas de travailleurs IT à distance.

Génération d'identités fictives

Jasper Sleet exploite les plateformes d'IA générative pour créer des personas numériques réalistes. Les acteurs utilisent des prompts spécifiques pour générer des listes de noms culturellement appropriés et des formats d'adresses e-mail correspondant aux profils ciblés.

Analyse automatisée d'offres d'emploi

Le groupe utilise l'IA pour analyser les offres d'emploi dans le développement logiciel et l'IT, extrayant automatiquement les compétences requises pour adapter leurs fausses identités aux rôles spécifiques.

Développement d'infrastructure malveillante

Coral Sleet tire parti de l'IA pour générer rapidement de faux sites d'entreprise, provisionner des infrastructures et tester leurs déploiements de manière automatisée.

Exemples de prompts malveillants

"Créer une liste de 100 noms grecs" ou "Créer une liste de formats d'adresses e-mail utilisant le nom Jane Doe" illustrent la simplicité des requêtes utilisées pour générer du contenu malveillant.

Évolution vers l'IA autonome et contournement des protections

Développement de malwares assisté par IA

Les cybercriminels exploitent les outils de codage basés sur l'IA pour :

- Générer et affiner du code malveillant

- Résoudre des erreurs de programmation

- Porter des composants de malwares vers différents langages

- Créer des scripts dynamiques qui modifient leur comportement en temps réel

Techniques de contournement (Jailbreaking)

Face aux mesures de protection intégrées dans les modèles d'IA, les acteurs malveillants développent des techniques de jailbreaking sophistiquées pour contourner les limitations et générer du contenu prohibé.

Émergence de l'IA agentique

Microsoft observe les premières expérimentations avec l'IA agentique, capable d'effectuer des tâches de manière autonome et de s'adapter aux résultats obtenus, bien que son utilisation reste limitée à la prise de décision plutôt qu'aux attaques autonomes.

Stratégies défensives face aux attaques IA-assistées

Traitement des campagnes de travailleurs IT comme risques internes

Étant donné que ces campagnes exploitent des accès légitimes, Microsoft recommande aux organisations de traiter ces schémas comme des risques internes nécessitant une surveillance particulière.

Mesures de protection recommandées

- Détection d'utilisation anormale des identifiants

- Durcissement des systèmes d'identité contre le phishing

- Sécurisation des systèmes d'IA internes susceptibles de devenir des cibles

- Mise en place de contrôles sur l'accès aux outils d'IA générative

Une tendance confirmée par l'écosystème de sécurité

L'observation de Microsoft s'inscrit dans une tendance plus large confirmée par d'autres acteurs majeurs de la cybersécurité. Google a récemment documenté l'abus de Gemini AI à toutes les étapes des cyberattaques, tandis qu'Amazon a identifié des campagnes similaires exploitant plusieurs services d'IA générative pour compromettre plus de 600 pare-feu FortiGate.

Perspective d'avenir

Cette démocratisation de l'IA dans les cyberattaques marque un tournant majeur, nécessitant une adaptation rapide des stratégies défensives et une sensibilisation accrue aux nouveaux vecteurs d'attaque émergents.

Conclusion : vers une nouvelle ère de la cybersécurité

L'intégration de l'intelligence artificielle dans les opérations malveillantes représente une évolution fondamentale du paysage des menaces. Les organisations doivent adapter leurs stratégies de sécurité pour faire face à des attaquants désormais capables d'automatiser et d'accélérer leurs opérations grâce à l'IA générative.

Cette transformation exige une approche holistique combinant détection comportementale avancée, durcissement des systèmes d'identité et sécurisation proactive des outils d'IA internes pour anticiper les prochaines évolutions de cette menace émergente.